Το Samsung Galaxy Watch7 Pro φιλοδοξεί να έχει μεγαλύτερη μπαταρία

Οι ρυθμιστικές αρχές της Νότιας Κορέας πιστοποίησαν την μπαταρία EB-BL705ABY με ονομαστική χωρητικότητα 578mAh, η οποία σαφώς θα χρησιμοποιηθεί σε ένα επερχόμενο έξυπνο ρολόι. Για λόγους αναφοράς, αυτό είναι ελαφρώς μεγαλύτερο από το Galaxy Watch5 Pro, το οποίο έχει ονομαστική χωρητικότητα 573mAh και τυπική χωρητικότητα (ο αριθμός που βλέπετε συνήθως) 590mAh. Αυτό είναι αρκετά μεγαλύτερο από τη δεύτερη μεγαλύτερη μπαταρία σε ένα πρόσφατο Galaxy Watch, το Watch6 Classic με 425mAh, σχεδόν 40% διαφορά. Αυτό σημαίνει ότι θα υπάρξει ένα Samsung Galaxy Watch7 Pro; Ίσως, πρόσφατες αναφορές υποστηρίζουν ότι θα υπάρξουν τρία μοντέλα αυτής της γενιάς με κλασικό και ένα Pro. Και ένα από τα τρία θα πρέπει να είναι ένα ορθογώνιο ρολόι, κάτι που έχουμε να δούμε από το Galaxy Live πριν από μια δεκαετία. Αν υποθέσουμε ότι το Classic θα παραμείνει στο σήμα κατατεθέν της περιστρεφόμενης στεφάνης, τότε είτε το Pro είτε το μοντέλο vanilla θα είναι ορθογώνιο. Μια ορθογώνια μπαταρία όπως η EB-BL705ABY ταιριάζει πολύ καλύτερα σε ένα ορθογώνιο ρολόι, αν και το Watch5 Pro των 45,4 χιλιοστών κατάφερε να χωρέσει την μπαταρία του μια χαρά. Όπως και να έχει, το νέο chipset Exynos που θα βρίσκεται στο εσωτερικό της σειράς Watch7 θα είναι 50% πιο αποδοτικό, οπότε ίσως δούμε ένα WearOS με πραγματικά εντυπωσιακή διάρκεια ζωής μπαταρία. Η σειρά Watch7 ενδέχεται να παρουσιαστεί στην ίδια εκδήλωση Galaxy Unpacked που φέρνει και τα foldables επόμενης γενιάς (αν και είναι πιθανό τα ρολόγια να πάρουν ξεχωριστή εκδήλωση αργότερα). Πηγή: kinitanea.gr

Eρευνητές δημιουργούν σύστημα πρόβλεψης τεχνητής νοημοσύνης που ξεπερνά τους ανθρώπους

Ερευνητές του Πανεπιστημίου του Μπέρκλεϊ στην Καλιφόρνια ανέπτυξαν ένα σύστημα πρόβλεψης τεχνητής νοημοσύνης που προβλέπει μελλοντικά γεγονότα με παρόμοια ακρίβεια με τη σοφία του ανθρώπινου πλήθους. Καθώς τα LLM δεν είναι ειδικά κατασκευασμένα για την πρόβλεψη γεγονότων, η ομάδα δημιούργησε ένα σύστημα πρόβλεψης πάνω στο GPT-4 χρησιμοποιώντας μια νέα προσέγγιση που ονομάζεται retrieval-augmented reasoning. Αυτή η διαδικασία πολλαπλών βημάτων περιελάμβανε την εκπαίδευση του GPT-4 να αναζητά σχετικές πληροφορίες, να αξιολογεί τη σχετικότητά τους και να τις ενσωματώνει στη διαδικασία συλλογισμού του πριν κάνει μια πρόβλεψη. Να πώς λειτουργεί: Ανάκτηση: Το σύστημα τεχνητής νοημοσύνης χρησιμοποιεί το GPT-4 για τη δημιουργία ερωτημάτων αναζήτησης με βάση το ερώτημα πρόβλεψης και τα υποερωτήματα, ανακτώντας ένα ευρύ σύνολο δυνητικά σχετικών ειδησεογραφικών άρθρων.Αξιολόγηση συνάφειας: Το GPT-4 αξιολογεί τη συνάφεια κάθε ανακτηθέντος άρθρου, απορρίπτοντας άρθρα με χαμηλή βαθμολογία για να περιορίσει τη δεξαμενή πληροφοριών.Περίληψη: Το GPT-4 περιορίζει κάθε άρθρο στα βασικά του σημεία, εστιάζοντας στις λεπτομέρειες που σχετίζονται με το ερώτημα πρόβλεψης.Συλλογισμός: Χρησιμοποιώντας “υποδείξεις”, το GPT-4 αναλύει τα συνοπτικά άρθρα και παράγει μια λεπτομερή πρόβλεψη με επεξηγηματικό σκεπτικό. Αυτές οι υποδείξεις καθοδηγούν τη διαδικασία σκέψης του μοντέλου, ενθαρρύνοντας μια συστηματική προσέγγιση στη συλλογιστική. Στη συνέχεια, η ομάδα του Μπέρκλεϊ προχώρησε το σύστημα ένα βήμα παραπέρα με αυτοελεγχόμενη τελειοποίηση. Δημιούργησαν έναν μεγάλο αριθμό προβλέψεων τεχνητής νοημοσύνης σε παρελθοντικές ερωτήσεις με γνωστές απαντήσεις και επέλεξαν παραδείγματα όπου η τεχνητή νοημοσύνη ξεπέρασε τη “σοφία του πλήθους” – που ορίζεται ως οι συγκεντρωτικές προβλέψεις των ανθρώπινων προβλέψεων. Με τη λεπτομερή ρύθμιση του GPT-4 σε αυτά τα παραδείγματα, οι ερευνητές δίδαξαν στο μοντέλο να μιμείται τα μοτίβα συλλογισμού που δημιουργούσαν τις καλύτερες προβλέψεις. Αποτελέσματα Όταν δοκιμάστηκε σε ερωτήσεις πρόβλεψης από τον Ιούνιο του 2023 και μετά, η τεχνητή νοημοσύνη πέτυχε βαθμολογία Brier 0,179, σε σύγκριση με την ανθρώπινη πρόβλεψη 0,149. Η τεχνητή νοημοσύνη είχε ιδιαίτερα καλές επιδόσεις σε ερωτήσεις με υψηλή ανθρώπινη αβεβαιότητα στην αρχή της διαδικασίας πρόβλεψης και όταν είχε πρόσβαση σε επαρκή αριθμό σχετικών άρθρων για ένα συγκεκριμένο θέμα. Οι συγγραφείς γράφουν στη μελέτη: “Εξ όσων γνωρίζουμε, αυτό είναι το πρώτο αυτοματοποιημένο σύστημα με ικανότητα πρόβλεψης που πλησιάζει το επίπεδο του ανθρώπινου πλήθους, το οποίο είναι γενικά ισχυρότερο από τους μεμονωμένους ανθρώπινους προγνώστες”. Υπήρξε μια μικρή ιδιορρυθμία, καθώς το σύστημα φάνηκε να επιδεινώνεται με περισσότερα άρθρα για να εργαστεί και, συνεπώς, με μεγαλύτερη βεβαιότητα για την πρόβλεψη. Αυτό μπορεί να οφείλεται στο γεγονός ότι το μοντέλο “αντισταθμίζει” τις προβλέψεις του. Οι ερευνητές το περιγράφουν ως εξής: “Υποθέτουμε ότι αυτό προέρχεται από την τάση του μοντέλου μας να αντισταθμίζει τις προβλέψεις λόγω της εκπαίδευσής του σε θέματα ασφάλειας”. Επιπτώσεις Σύμφωνα με τους ερευνητές οι επιχειρήσεις και οι αξιωματούχοι δημόσιας υγείας θα μπορούσαν όλοι να επωφεληθούν από αυτή τη μορφή γλωσσικής πρόβλεψης με βάση την τεχνητή νοημοσύνη. “Στο μέλλον, οι υπεύθυνοι για τη λήψη πολιτικών αποφάσεων μπορεί να συμβουλεύονται τις ΤΝ σχετικά με το ποιες ενέργειες θα επιφέρουν πιθανότατα τα επιθυμητά αποτελέσματα”, δηλώνει ο Dan Hendrycks από το Center for AI Safety στην Καλιφόρνια. Προτείνει ότι τα μοντέλα πρόβλεψης θα μπορούσαν να αντιμετωπίσουν τους επερχόμενους κινδύνους που θέτει η ΤΝ. “Τα ρομπότ πρόβλεψης θα μας βοηθούσαν να προβλέψουμε και να αποφύγουμε αυτούς τους κινδύνους”, δήλωσε ο Hendrycks. Έχουν γίνει και άλλες προσπάθειες πρόβλεψης σύνθετων γεγονότων ζωής με την ΤΝ, συμπεριλαμβανομένου ενός μοντέλου που εκπαιδεύτηκε από Δανούς ερευνητές για να προβλέπει τους κινδύνους πρόωρου θανάτου. Η αξιοποίηση της τεχνητής νοημοσύνης για εφαρμογές πρόβλεψης που επηρεάζουν τη ζωή των ανθρώπων θέτει ηθικά ζητήματα, όπως η διασφάλιση ότι τα συστήματα αυτά είναι διαφανή, αμερόληπτα και ηθικά θεμελιωμένα. Αυτή η νέα μελέτη του Μπέρκλεϊ περιγράφει πώς η τεχνητή νοημοσύνη μπορεί να κάνει αποτελεσματικές προβλέψεις, αλλά δεν μπορούμε να μετρήσουμε με πόση ακρίβεια καταλήγει στις αποφάσεις της. Η χρήση της τεχνητής νοημοσύνης για την πρόβλεψη σημαντικών κοινωνικών και ατομικών γεγονότων μπορεί να μοιάζει με δυστοπική ιδέα, αλλά είναι ήδη μια ευρέως διαδεδομένη πρακτική σε πολλά μέρη του κόσμου. Σε αρκετές δημοκρατικές χώρες, συμπεριλαμβανομένων των ΗΠΑ, του Ηνωμένου Βασιλείου, της Βραζιλίας, της Αυστραλίας και των Κάτω Χωρών, η τεχνητή νοημοσύνη χρησιμοποιείται για την αστυνόμευση, την επιτήρηση και τη λήψη αποφάσεων για την κοινωνική πρόνοια. Μπορεί μια τεχνητή νοημοσύνη να προβλέπει πτυχές του μέλλοντός σας αυτή τη στιγμή; Είναι σίγουρα πιθανό. Πηγή: kinitanea.gr

Έρχεται νέα αύξηση τιμών για τις συνδρομές του Spotify – Τι γίνεται με την Ελλάδα;

Και υπάρχει λόγος Παρόλο που το Spotify για πολλά χρόνια είχε διατηρήσει τις τιμές των συνδρόμων του αρκετά προσιτές, μέσα στο ευρύτερο πλαίσιο των αυξήσεων που βιώνουμε τους τελευταίους μήνες, και η Σουηδική εταιρία είχε κάνει αναπροσαρμογές πέρυσι τον Ιούλιο. Τώρα, μέσα σε λιγότερο από ένα χρόνο, το Spotify ετοιμάζεται να προβεί ξανά σε αυξήσεις! Περνώντας σε λεπτομέρειες, το εξαιρετικά αξιόπιστο δημοσιογραφικό μέσο Bloomberg μεταφέρει πως το Spotify σχεδιάζει να αυξήσει τις τιμές του από 1$ μέχρι 2$ σε πέντε αγορές, μεταξύ των οποίων το Ηνωμένο Βασίλειο, η Αυστραλία και το Πκιστάν. Τι γίνεται με την Ελλάδα;Η αύξηση αυτή θα πραγματοποιηθεί εντός του Απριλίου και φαίνεται πως είναι μάλλον η αρχή μιας ευρύτερης αύξησης. Συγκεκριμένα, οι τιμές θα αυξηθούν και για τους ακροατές στις Ηνωμένες Πολιτείες αργότερα μέσα στο έτος, χωρίς να υπάρχει για την ώρα κάποια πληροφορία σχετικά με τα σχέδια της εταιρίας για τις χώρες της Ευρωπαϊκής Ένωσης. Επιπλέον, όπως μεταφέρει το μέσο, η αύξηση αυτή θα επηρεάσει τους συνδρομητές που θέλουν να έχουν πρόσβαση σε audiobooks μέσω του Spotify. Πρόκειται για μια πολύ χρήσιμη δυνατότητα που επεκτείνεται σε όλο και περισσότερες χώρες. Διαθέσιμη θα γίνει, λοιπόν, μια νέα βασική συνδρομή που θα μείνει στα $10.99, για μουσική και Podcasts, ενώ το Premium που περιλαμβάνει και audiobooks θα έρχεται στην αυξημένη τιμή. Για την ιστορία, το Bloomberg επισημαίνει πως το Spotify εξακολουθεί να έχει στα πλάνα του και την “Supremium” συνδρομή που θα προσθέσει στην υπηρεσία επιτέλους το πολυπόθητο lossless streaming. Ακόμη δεν υπάρχει όμως κάποιο χρονοδιάγραμμα σχετικά με το πότε μπορούμε να περιμένουμε τις εν λόγω προσθήκες. Πηγή: unboxholics.com

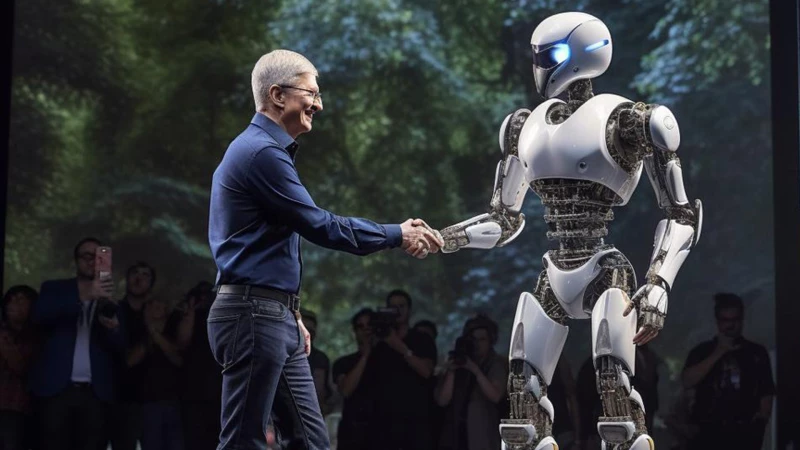

Η Apple θα δημιουργήσει προσωπικά ρομπότ

Μετά το αυτοκίνητο στρέφεται στη ρομποτική Ψάχνοντας το επόμενο επαναστατικό προϊόν για να διατηρηθεί στην κορυφή της αγοράς και αφού η ανάπτυξη ενός αυτοκινήτου γνώρισε πρόωρο τέλος, η Apple αποφάσισε να επικεντρωθεί στη ρομποτική. Σύμφωνα με τον Mark Gruman του Bloomberg, η εταιρία εξερευνά τη δυνατότητα ανάπτυξης ενός προσωπικού ρομποτικού βοηθού. Η ανάπτυξη βρίσκεται σε πολύ πρώιμα στάδια, έχει ως στόχο όμως ένα κινητό ρομπότ το οποίο θα κινείται αυτόνομα στο σπίτι, ενώ ήδη έχει κατασκευάσει μία επιτραπέζια συσκευή η οποία κινεί μια οθόνη, με στόχο να μιμείται τις κινήσεις του κεφαλιού και να “κλειδώνει” σε έναν άνθρωπο, για καλύτερη εμπειρία video κλήσεων. Η Apple εξερευνά αλγορίθμους για πλοήγηση και υπεύθυνο για την ανάπτυξη των προσωπικών ρομπότ είναι το τμήμα οικιακών συσκευών. Επίσης, ορισμένοι μηχανικοί από το αποτυχημένο project αυτοκινήτου, έχουν μεταφερθεί σε αυτήν την ομάδα. Ωστόσο τα ρομπότ δεν είναι τόσο απαραίτητα όσο είναι τα τηλέφωνά μας σήμερα και η Apple ανησυχεί για το αν ο κόσμος θα πληρώσει για τα ρομπότ που έχει στο μυαλό της. Τα στελέχη της εταιρίας δεν μπορούν ακόμα να καταλήξουν σε συμφωνία για το αν η Apple πρέπει να συνεχίσει να επιδιώκει αυτόν το στόχο. Πηγή: unboxholics.com

Χρονιά εκλογών για το 1/4 του πληθυσμού της Γης και τα deepfakes αποτελούν απειλή

Ένα όπλο μαζικής εξαπάτησης Η προπαγάνδα και τα fake news δεν είναι τωρινό φαινόμενο, αλλά η άνοδος της τεχνητής νοημοσύνης έχει δώσει άλλη διάσταση στην εξαπάτηση, αφού δεν μπορούμε πλέον να πιστεύουμε ούτε τα ίδια μας τα μάτια. Απίστευτα ρεαλιστικές εικόνες, ηχητικά αποσπάσματα, ακόμα και videos, παράγονται με ευκολία, έχοντας ως πρωταγωνιστές πολιτικούς και αξιωματούχους κρατών, σε δηλώσεις που ποτέ δεν έκαναν και σε στιγμές που ποτέ δεν υπήρξαν στην πραγματικότητα. Και με το 2024 να είναι χρονιά εκλογών για το 1/4 του παγκόσμιου πληθυσμού, οι ανησυχίες για εξαπάτηση των ψηφοφόρων αυξάνεται δραματικά. Η ESET πραγματοποίησε μία έρευνα και παραθέτει τα συμπεράσματα στο δελτίο Τύπου που ακολουθεί. “Το 2024, εκτιμάται ότι περίπου το ένα τέταρτο του παγκόσμιου πληθυσμού θα προσέλθει στις κάλπες. Αυτό αυξάνει τις ανησυχίες για πιθανή παραπληροφόρηση και απάτες, οι οποίες ενδέχεται να αξιοποιήσουν την τεχνητή νοημοσύνη. Κακόβουλοι φορείς μπορούν να χρησιμοποιήσουν αυτά τα μέσα για να επηρεάσουν τα αποτελέσματα των εκλογών, ενώ εμπειρογνώμονες εκφράζουν φόβους για τις επιπτώσεις της γενικευμένης χρήσης των deepfakes, προειδοποιεί ο Phil Muncaster από την ομάδα της παγκόσμιας εταιρίας ψηφιακής ασφάλειας ESET. Σχεδόν δύο δισεκατομμύρια άνθρωποι θα πάνε στις κάλπες φέτος για να ψηφίσουν τους αντιπροσώπους και τους ηγέτες που προτιμούν. Σημαντικές εκλογικές αναμετρήσεις θα διεξαχθούν σε πολλές χώρες, όπως στις ΗΠΑ, το Ηνωμένο Βασίλειο και την Ινδία. Επίσης το 2024, θα πραγματοποιηθούν οι εκλογές για το Ευρωπαϊκό Κοινοβούλιο. Αυτές οι εκλογικές αναμετρήσεις μπορεί να αλλάξουν το πολιτικό τοπίο και την κατεύθυνση της γεωπολιτικής για τα επόμενα χρόνια – και όχι μόνο. Από τη θεωρία στην πράξη Είναι ανησυχητικό ότι τα deepfakes είναι πιθανό να επηρεάσουν τους ψηφοφόρους. Τον Ιανουάριο του 2024, ένα deepfake ηχητικό μήνυμα του προέδρου των ΗΠΑ Τζο Μπάιντεν κυκλοφόρησε μέσω ρομποτικής κλήσης σε άγνωστο αριθμό ψηφοφόρων των προκριματικών εκλογών στο Νιου Χαμσάιρ. Το μήνυμα καλούσε τους ψηφοφόρους να μην προσέλθουν στις κάλπες και αντ’ αυτού να “φυλάξουν την ψήφο τους για τις εκλογές του Νοεμβρίου”. Ο αριθμός αναγνώρισης κλήσης που εμφανιζόταν ήταν επίσης πλαστογραφημένος ώστε να φαίνεται ότι το αυτοματοποιημένο μήνυμα στάλθηκε από τον προσωπικό αριθμό της Kathy Sullivan, πρώην προέδρου του Δημοκρατικού Κόμματος της πολιτείας, η οποία τώρα ηγείται μιας επιτροπής για τη στήριξη της υποψηφιότητας Τζο Μπάιντεν. Δεν είναι δύσκολο να καταλάβει κανείς πώς τέτοιες κλήσεις θα μπορούσαν να χρησιμοποιηθούν για να αποτρέψουν τους ψηφοφόρους να προσέλθουν στις κάλπες για να ψηφίσουν τον υποψήφιο της προτίμησής τους ενόψει των προεδρικών εκλογών του Νοεμβρίου. Ο κίνδυνος θα είναι μεγάλος σε αμφίρροπες εκλογικές αναμετρήσεις, όπου η μετατόπιση ενός μικρού αριθμού ψηφοφόρων από τη μία πλευρά στην άλλη καθορίζει το αποτέλεσμα. Μια τέτοια στοχευμένη εκστρατεία θα μπορούσε να προκαλέσει ανυπολόγιστη ζημιά επηρεάζοντας μερικές χιλιάδες ψηφοφόρους σε σημαντικές πολιτείες που ενδέχεται να κρίνουν το αποτέλεσμα των εκλογών. Η απειλή παραπληροφόρησης μέσω deepfake Η παραπληροφόρηση και αποπληροφόρηση κατατάχθηκαν πρόσφατα από το Παγκόσμιο Οικονομικό Φόρουμ (WEF) ως ο νούμερο ένα παγκόσμιος κίνδυνος για τα επόμενα δύο χρόνια. Η έκθεση προειδοποιεί: “Το συνθετικό περιεχόμενο θα χειραγωγήσει τα άτομα, θα βλάψει τις οικονομίες και θα διασπάσει τις κοινωνίες με πολυάριθμους τρόπους κατά τα επόμενα δύο χρόνια … υπάρχει ο κίνδυνος ορισμένες κυβερνήσεις να δράσουν πολύ αργά, αντιμετωπίζοντας ένα συμβιβασμό μεταξύ της αποτροπής της παραπληροφόρησης και της προστασίας της ελευθερίας του λόγου”. (Deep)faking it Εργαλεία όπως το ChatGPT και η Γενετική Τεχνητή Νοημοσύνη (GenAI) έδωσαν τη δυνατότητα σε ένα ευρύτερο σύνολο ατόμων να συμμετάσχουν στη δημιουργία εκστρατειών παραπληροφόρησης με τη χρήση της τεχνολογίας. Με τη βοήθεια της τεχνητής νοημοσύνης οι κακόβουλοι φορείς έχουν περισσότερο χρόνο να εργαστούν πάνω στα μηνύματά τους, ενισχύοντας τις προσπάθειες τους για να διασφαλίσουν ότι το ψεύτικο περιεχόμενό τους θα δημοσιευτεί και θα ακουστεί. Στο πλαίσιο των εκλογικών αναμετρήσεων, τα deepfakes θα μπορούσαν προφανώς να χρησιμοποιηθούν για να διαβρώσουν την εμπιστοσύνη των ψηφοφόρων σε έναν συγκεκριμένο υποψήφιο. Εξάλλου, είναι ευκολότερο να πείσεις κάποιον να μην κάνει κάτι παρά το αντίθετο. Εάν οι υποστηρικτές ενός πολιτικού κόμματος ή υποψηφίου μπορούν να επηρεαστούν κατάλληλα από ψεύτικα ηχητικά αρχεία ή βίντεο, αυτό θα έδινε μια σίγουρη νίκη στους αντιπάλους. Σε ορισμένες περιπτώσεις, τα κράτη-παρίες μπορεί να επιδιώξουν να υπονομεύσουν την εμπιστοσύνη στη δημοκρατική διαδικασία, ώστε όποιος κερδίσει να δυσκολευτεί να κυβερνήσει. Στο επίκεντρο της διαδικασίας βρίσκεται μια απλή αλήθεια: όταν οι άνθρωποι επεξεργάζονται πληροφορίες, τείνουν να εκτιμούν την ποσότητα και την ευκολία κατανόησης. Αυτό σημαίνει ότι όσο περισσότερο περιεχόμενο βλέπουμε με παρόμοιο μήνυμα και όσο πιο εύκολο είναι να το κατανοήσουμε, τόσο μεγαλύτερη είναι η πιθανότητα να το πιστέψουμε. Αυτός είναι ο λόγος για τον οποίο οι εκστρατείες μάρκετινγκ αποτελούνται από σύντομα και συνεχώς επαναλαμβανόμενα μηνύματα. Προσθέστε σε αυτό το γεγονός ότι η διάκριση των deepfakes από το πραγματικό περιεχόμενο γίνεται όλο και πιο δύσκολη, και έχετε μια πιθανή συνταγή για την καταστροφή της δημοκρατίας. Τι κάνουν οι εταιρείες τεχνολογίας γι’ αυτό; Τόσο το YouTube όσο και το Facebook ανταποκρίθηκαν αργά σε ορισμένα deepfakes που είχαν στόχο να επηρεάσουν πρόσφατες εκλογές. Αυτό συμβαίνει παρά τη νέα νομοθεσία της Ευρωπαϊκής Ένωσης (Digital Services Act) που απαιτεί από τις εταιρείες μέσων κοινωνικής δικτύωσης να πατάξουν τις απόπειρες χειραγώγησης των εκλογών. Από την πλευρά της, η OpenAI δήλωσε ότι θα εφαρμόσει τα ψηφιακά διαπιστευτήρια του Συνασπισμού για την Απόδειξη και την Αυθεντικότητα του Περιεχομένου (C2PA) για τις εικόνες που παράγονται από το DALL-E 3. Η τεχνολογία κρυπτογραφικής υδατογράφησης – που δοκιμάζεται επίσης από τη Meta και τη Google – έχει σχεδιαστεί για να καταστήσει δυσκολότερη την παραγωγή πλαστών εικόνων. Ωστόσο, πρόκειται για μικρά βήματα και υπάρχουν δικαιολογημένες ανησυχίες ότι η απάντηση στην απειλή δεν θα είναι αρκετή και θα έρθει με καθυστέρηση, καθώς ο πυρετός των εκλογών κατακλύζει τον πλανήτη. Ειδικά όταν η διάδοση των deepfakes γίνεται σε σχετικά κλειστά δίκτυα, σε ομάδες WhatsApp ή μέσω τηλεφωνικών κλήσεων, θα είναι δύσκολο να εντοπιστεί και να διαψευστεί γρήγορα κάθε πλαστό ηχητικό αρχείο ή βίντεο. Η θεωρία της “προκατάληψης της αγκύρωσης” υποδηλώνει ότι η πρώτη πληροφορία που ακούν οι άνθρωποι είναι αυτή που μένει στο μυαλό τους, ακόμη και αν αποδειχθεί ψευδής, λέει ο Muncaster από την ESET. Αν οι deepfakers προσεγγίσουν πρώτοι στους ψηφοφόρους που αμφιταλαντεύονται, κανείς δεν γνωρίζει ποιος θα είναι ο τελικός νικητής. Στην εποχή των